Latest News

Sony hält sich bei PlayStation 6 bedeckt – Neue Hinweise zu Release, Preis und Strategie

Stuttgart setzt mit „The Gate“ auf digitale Kultur und KI-Debatten

Versicherungsstreit nach Schmuckdiebstahl: Gericht weist Klage von Verona und Franjo Pooth ab

Take-Two-Aktie legt wegen GTA-6-Spekulationen deutlich zu

Beamtenbesoldung 2026: Diese Bundesländer erhöhen die Gehälter im öffentlichen Dienst

Politik

Lifestyle

Region

Allgemein

Kultur

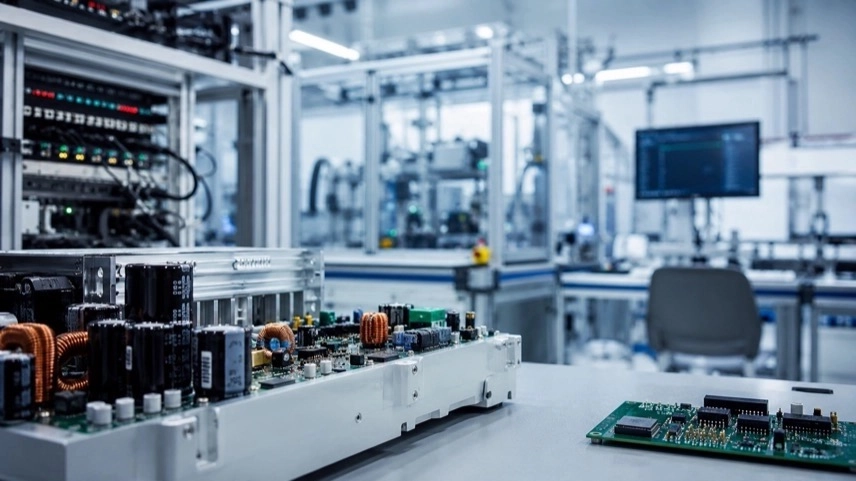

Produkte

Allgemeines

Aktuelles

Wirtschaft

Umwelt

Regionales

Sport

Ausland

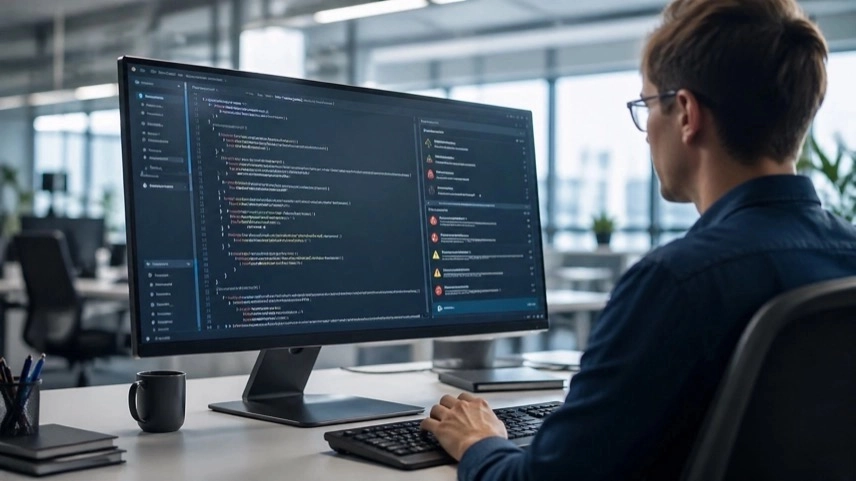

Digitalisierung

Digitalisierung

Google und SpaceX prüfen offenbar KI-Rechenzentren im Orbit

Iran Krieg